此处用于记录我学习 MIT 18.06 Linear Algebra 的笔记。

顺便学习 Latex 排版。

每次看完都会忘记,比较难受,尝试记住

线性无关

当一组向量 满足以下条件时,称其为线性无关:

否则称其为线性相关。

向量组 线性无关的充要条件是 ,其中 是向量的个数。

可以通过行简化阶梯形矩阵来判断向量组是否线性无关,如果矩阵 的行简化阶梯形矩阵有 个主元,则向量组线性无关,否则线性相关。

向量组 和 等价的充要条件是 。

能被向量组 线性表示的充要条件是 。

Tip: 非主元列 为 ,则 的线性表示为 ,其中 是主元列。(即取主元,然后组合 的每一个元素)

-

若 ,不能推出 可以被 线性表示。

-

若 线性相关,不能推出 可以被其他向量线性表示。

线性方程组的解

设有线性方程组 ,其中 是 矩阵, 是 向量, 是 向量。

考虑 :

- 有解 ->

-

- 唯一解 ->

-

- 无穷多解 ->

- 无解 ->

考虑齐次线性方程组 :

- R(A) = n -> 唯一解

- R(A) < n -> 无穷多解

从几何上看,线性方程组 有解,表示向量 可以被矩阵 的列空间线性表示。

如果有唯一解,表示矩阵 的列空间是 ,且矩阵 的列向量线性无关。

如果有无穷多解,表示矩阵 的列空间是 ,但矩阵 的列向量线性相关。

如果无解,表示向量 不在矩阵 的列空间内。

正交矩阵 Orthogonal Matrix

正交矩阵有 满足 。

因为 的每一列 都是单位向量,并且两两正交,所以 。

因此,在 和 相乘时,对应元素为 。只有当 时,才会有非零值,且为 1。否则任意两列 和 的互相垂直,内积为 0。

此外,因为有 ,所以 。

正交矩阵的几何意义

矩阵 进行变换时, 会保持向量的长度和角度不变,然后变换基,也可以理解为旋转和镜像。

Schmidt Orthogonalization 施密特正交化

给定一组线性无关的向量 ,可以通过施密特正交化将其转换为一组正交向量 。

具体步骤如下:

-

设 。

-

对于 ,计算 在 上的投影,并将其从 中减去:

-

将 归一化,得到 :

通过上述步骤,可以得到一组正交向量 。

举例来说,给定向量 , 和 。

-

设 。

-

计算 在 上的投影:

然后计算 :

-

然后计算 :

计算 在 和 上的投影:

然后计算 :

-

最后归一化得到

行列式 Determinant

行列式是一个标量值,表示矩阵的某些性质。对于 矩阵 ,其行列式记为 或 。

行列式有三个重要性质:

-

The determinant of the n by n identity matrix is 1. 即 。

-

The determinant changes sign when two rows are exchanged. 即交换矩阵的两行,行列式的值会变号。

-

The determinant is a linear function of each row separately. 即行列式对每一行都是线性函数。

-

如果矩阵的一行乘以一个标量 ,则行列式也乘以 。

-

如果矩阵的一行是两行之和,则行列式等于这两行分别拆分计算的行列式之和。

-

利用这三个性质,可以推导出其他性质:

-

如果矩阵有两行相同,则行列式为 0。

因为根据性质 2,交换这两行会使行列式变号,但行列式并没有发生变化,所以行列式必须为 0。

-

将行列式的一行加上或者减去另一行,行列式的值不变。

因为根据性质 3,行列式是线性函数,所以可以将该行拆分成两部分,一部分是原来的行,另一部分是被加上或者减去的行。

同时,拆分出来的矩阵,将所乘的标量提出后,会有两行相同,根据性质 4,行列式为 0。因此,行列式相加后的值不变。

-

如果行列式有全零行,那么行列式为 0。

因为可以将该行加上或者减去其他行,变成两行相同的情况,根据性质 5,行列式的值不变,又因为根据性质 4,所以行列式为 0。

-

如果行列式是三角矩阵(上三角矩阵或者下三角矩阵),则行列式等于对角线元素的乘积。

因为可以通过将非对角线元素所在的行加上或者减去其他行,将其变成对角矩阵,而根据性质 3,提出每一行的对角线上的标量后,留下的矩阵是单位矩阵,行列式为 1。

因此,行列式等于对角线元素的乘积。

-

如果 是奇异矩阵,则 。如果 是可逆的矩阵,则 。

将矩阵化为行阶梯形矩阵时,奇异矩阵会有全零行,根据性质 6,行列式为 0。

-

。

-

。

当 时,有 ,根据性质 9,,所以 ,即 。

-

。

当 不是奇异矩阵时,有 ,可以分解为 ,其中 是置换矩阵, 是下三角矩阵, 是上三角矩阵。

因为 ,因为

,因为 的对角线上都 1

,因为上下三角矩阵的行列式只取决于对角线元素

所以 。

当 是奇异矩阵时,,同样有 。

因为性质 11,因此行列式的行和列操作是一样的。

行列式的几何意义

行列式的绝对值表示矩阵变换后,空间的变化倍数,或者以单位立方体为例的体积变化倍数。

如果 ,表示变换保持了空间的定向;如果 ,表示变换改变了空间的定向(例如镜像反转)。

特例有 ,表示单位立方体的体积没有变化,空间没有变化。

范德蒙德行列式

设有 个不同的数 ,则范德蒙德行列式定义为:

范德蒙德行列式的值为:

迹 Trace

迹是矩阵对角线元素的和,记为 。

迹同时也是特征值之和,因此迹的几何意义可以看作矩阵对空间的平均拉伸,尽管没有平均掉(没有除以 )。

特征向量与特征值 Eigenvectors and Eigenvalues

设有矩阵 ,如果存在向量 和标量 ,使得 ,则称 为矩阵 的特征向量, 为对应的特征值。

因此有

要使得 有非零解,必须使得 为奇异矩阵,。

求特征值 Finding Eigenvalues

要找到矩阵 的特征值,需要解特征多项式 。 该多项式的根即为矩阵 的特征值。可能是重根。

求特征向量 Finding Eigenvectors

对于每个特征值 ,将其代入方程 ,通过求解该齐次线性方程组,可以找到对应的特征向量 。特征向量不一定唯一,当特征值是重根时,可能有多个线性无关的特征向量。

,因此, 的特征值的倒数是 的特征值,特征向量相同。

证明如下:

矩阵的幂次的特征值是对应特征值的幂次:

此外,矩阵的行列式等于其特征值的乘积:

矩阵的迹等于其特征值的和:

两个矩阵相加的特征值等于各自特征值的和并不总是成立,因为特征向量大多数情况下不同,但是同一矩阵内,矩阵多项式的特征值等于矩阵的特征值的多项式值。见 矩阵的多项式、对角化与特征值 部分。

特征值和特征向量的几何意义

从几何上看,实特征值对应的是矩阵对特征向量(输入向量)方向进行伸缩变换,而复特征值对应的是矩阵对输入向量进行旋转变换。

不同特征值的特征向量线性无关:

假设有 和 ,其中 。

假设 ,代入方程:

与 矛盾,因此 和 线性无关。

对角化 Diagonalization

如果一个矩阵 有 个线性无关的特征向量 ,则可以将这些特征向量组成一个矩阵 。对应的特征值组成对角矩阵 。

则有 。如果 可逆,则可以写成 ,称为矩阵 的对角化形式。

因为 需要可逆,因此需要 A 有 个线性无关的特征向量。必须满足矩阵 的特征多项式有 个不同的根,或者重根的代数重数等于几何重数。

有了对角化形式后,可以方便地计算矩阵的幂次 ,其中 只需对角线元素取幂。

矩阵的多项式、对角化与特征值

对于求矩阵多项式 ,如果知道矩阵 可以对角化,可以简化计算。

设 , 则有

其中 只需对角线元素取多项式值即可。

这将对 的多项式计算简化为对对角矩阵 的多项式,或者是对角元素的多项式计算。

此外,对于 如果已知矩阵 的特征值

对称矩阵 Symmetric Matrix

当矩阵 满足 时,称其为对称矩阵。

回顾上面的对角化,可以得到 。

由于 是对称矩阵,有 ,因此 。

是对角矩阵,因此 。

因此有 。

两边同时左乘 ,右乘 ,得到 。

所以 满足 ,即 是正交矩阵。

因此,对称矩阵可以被正交对角化,即 ,其中 是正交矩阵, 是对角矩阵。

对称矩阵的以下性质:

-

特征值为实数。

-

不同特征值对应的特征向量正交。

假设实矩阵 有 , , 则一定有 。

对于 ,两边左乘 ,得到 。

对于 ,两边右乘 ,得到 。

对比可知 ,当且仅当 时,,即 为实数。

如何证明 呢?

假设 ,则 ,因为 和 不全为 0,所以 。

因此,实对称矩阵的特征值为实数。

Real Eigenvalues All the eigenvalues of a real symmetric matrix are real.

注意:假如 是复矩阵,需要 才能保证特征值为实数。

假设有 和 ,其中 。

对于 ,左乘 ,得到 。

又因为 ,所以 。

所以可得 。

所以 。

所以 。

Orthogonal Eigenvectors Eigenvectors of a real symmetric matrix (when they correspond to different eigenvalues) are always perpendicular.

注意:不是所有特征向量都正交,对应不同特征值的特征向量一定正交,同一特征值的特征向量有可能正交。对称矩阵中,同一特征值的特征向量可以通过施密特正交化变成正交的。

求一个实对称矩阵的特征值和特征向量和 的步骤:

-

求解特征多项式 ,得到所有特征值 。

-

对于每个特征值 ,求解齐次线性方程组 ,得到对应的特征向量 。

-

此时特征向量是正交的但未归一化,将每个特征向量 归一化,得到单位特征向量 。

-

将所有特征向量组成矩阵 ,并将对应的特征值组成对角矩阵 。

比如

-

求解特征多项式,得到特征值 和 。

-

对于 ,求解 :

解得特征向量 。

对于 ,求解 :

解得特征向量 。

-

归一化特征向量:

-

组成矩阵 和 :

对于任意 , 和 都是对称矩阵。

,则 以及 。(在 SVD 分解有用)

相似矩阵

若存在 和 ,使得 ,则称矩阵 和 是相似矩阵。

相似矩阵有相同的特征值。

假设有 和 。

则有

得

因此 有相同的特征值 ,对应的特征向量为 。

显然因为 为特征值的乘积,所以相似矩阵有相同的行列式,以及特征值的和相同推出相同的迹 。

两个矩阵相似,他们的特征值相同,但是相反,两个矩阵特征值相同,并不一定相似。

比如

后者是一个对角矩阵、单位矩阵,但是它没法取 使得 ,虽然他们有相同的特征值 。

对于 ,其中 是标量, 是单位矩阵,它的相似矩阵只有它自己。取可逆矩阵 ,则有 。

对于 ,可以取无穷个可逆矩阵 ,使得 ,这些 的相似矩阵 组成一个相似类,他们有相同的特征值、行列式、迹等性质,互相之间可以通过相似变换转换,同时他们表达了同一个线性变换,只是基不同。(基由 决定)

在这些相似类中,有的矩阵可以对角化,有的不能对角化。可对角化的可以都由其对角矩阵相似变换得到,其他的则例如上面的 这种形式,他们都可以由对应的 Jordan 标准型相似变换而来。对角矩阵这种相似类里面,更特殊的就是 这种形式。

Jordan 标准型 Jordan Normal Form

对于任意矩阵 ,都存在一个可逆矩阵 ,使得 ,其中 是 Jordan 标准型矩阵。

是由 Jordan 块组成的块对角矩阵。Jordan 块是一个上三角矩阵,对角线上的元素都是同一个标量 ,紧接着主对角线上方的元素(上次对角线)全是 1,其余元素全是 0。

例如,矩阵

有两个 Jordan 块:一个是 的块

,对应特征值 ,另一个是 的块

,对应特征值 。

特殊的,对角矩阵就是 Jordan 标准型的特例,每个 Jordan 块为 。

每个 Jordan 块对应一个特征值 ,Jordan 块的大小等于该特征值的代数重数,而几何重数始终为 1。

正定矩阵 Positive Definite Matrix

The number of positive eigenvalues of S equals the number of positive pivots.

正特征值的数量和正主元的数量相等。

所有主子矩阵的行列式为正数

构建

则

通过构建这样一个 ,证明 为任意向量的时候,,所以每一个主子矩阵都是正定矩阵,特征值都是正数,行列式为特征值的乘积,所以行列式大于零。

所有主元为正数

因为不需要行交换的情况下,通过高斯消元法, 将矩阵 化为上三角矩阵 ,主元就是上三角矩阵的对角线元素,,而 ,所以行列式等于主元的乘积,又因为 ,所以主元的乘积大于零,而每一个主元又是每一个主子矩阵的行列式与前一个主子矩阵行列式的比值,所以每一个主元都大于零。

TODO: 惯性定理

Energy-based Definition

对于 ,有 。

当 是正定矩阵时,,所以对于任意 ,有 。

比如

则有

因此,正定矩阵可以看作是一个能量函数,将向量 映射到一个正的标量值。

If and are symmetric positive definite, so is

如果 和 是对称正定矩阵,则 也是对称正定矩阵。

因为

显然成立

If the columns of are independent, then is positive definite.

当 是满秩矩阵时, 是正定矩阵。

因为

当 的列线性无关时,,所以 。

综上,当 是正定矩阵,有以下五个等价条件:

-

所有特征值均为正数。

-

所有主元均为正数。

-

对于所有非零向量 ,有 。

-

存在满秩矩阵 ,使得 。

-

所有左上三角子矩阵的行列式均为正数,即

Positive Semidefinite Matrices 正半定矩阵

当矩阵 满足对于所有非零向量 ,有 时,称其为正半定矩阵,这包括正定矩阵和一些奇异矩阵。

以及它的特征值 满足 。

比如

和

同时,将 分解为 ,,比如

和 二次型

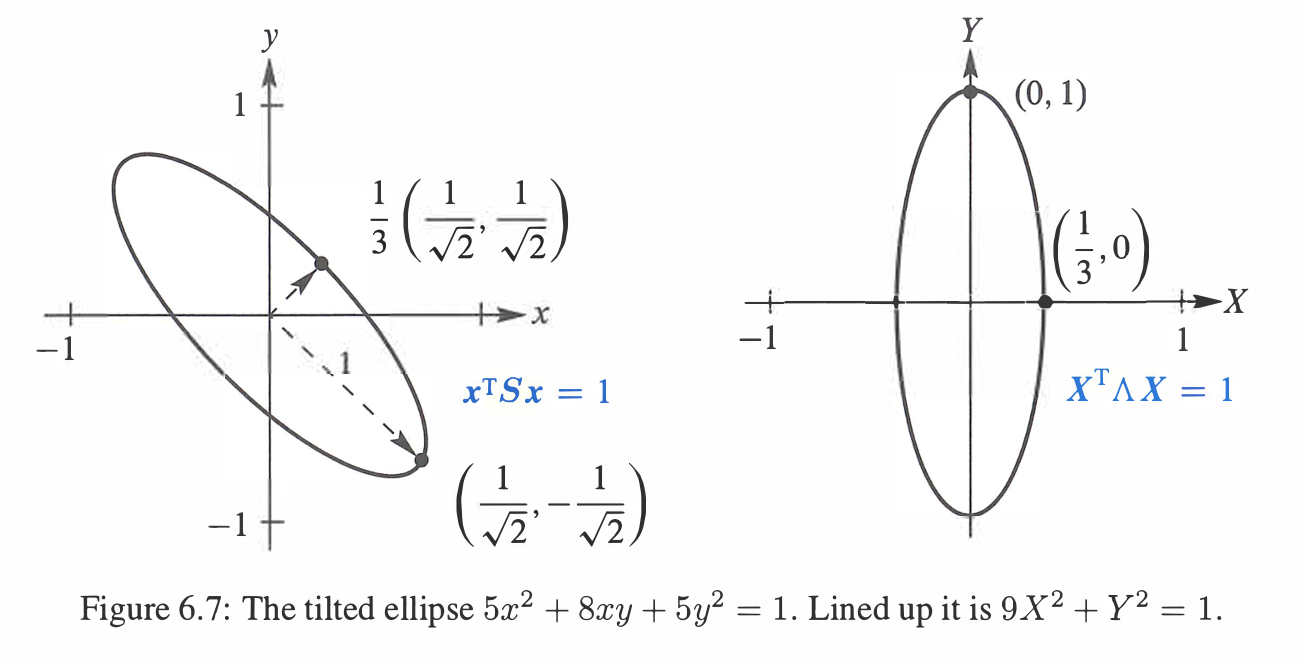

给定二次曲线方程,,可以将其表示为矩阵形式:

当 是正定矩阵时, 描述的是斜着的椭圆。

通过配方法,可以将其化为标准形式:

比如

可以写成矩阵形式:

根据 ,计算出 和 :

计算矩阵的特征值和特征向量:

解得特征值为 和 。

对应的特征向量为 和 。

将特征向量归一化,得到正交矩阵:

The axes of the tilted ellipse point along those eigenvectors.

由图可见,椭圆的主轴与特征向量方向一致。

它的主轴长度与特征值相关,主半轴长度为 ,半短轴长度为 。

在这里,主半轴长度为 ,半短轴长度为 。

因为是斜着的,所以两个长短轴各端点分别为

和

- The tilted ellipse is associated with S. Its equation is x T Sx = l. 倾斜椭圆对应的是 矩阵 ,其方程为 。

- The lined-up ellipse is associated with A. Its equation is XT AX = 1. 对齐椭圆对应的是 矩阵 ,其方程为 。

- The rotation matrix that lines up the ellipse is the eigenvector matrix Q. 旋转矩阵 可以将椭圆对齐。

用旋转矩阵 将 椭圆对齐:

将 和 变换到 和 ,,即

代入原方程 ,得到 ,即

因为 ,所以有

代入

得

就是对齐后的椭圆方程,这两个椭圆只是角度不同。

给定二次齐次函数

当 时,取 ,则拆分得

将其用矩阵表示,

因此,二次齐次函数可以表示为矩阵形式 。

规范式指的是 ,当 时,就是椭圆的标准方程。

利用特征值和特征向量,可以将二次齐次函数化为规范式。

当 时,有

令 ,则有

这样可以通过判断特征值的符号,来判断二次齐次函数是否正定、负定还是不定,从而来判断二次齐次函数的截面形状()和几何形状:

-

当所有特征值均为正时,表示一个椭圆(或椭球体)。

-

当所有特征值均为负时,表示一个椭圆(或椭球体),但方向相反。

-

当特征值有正有负时,表示一个双曲线(或双曲面)。

和圆锥曲线的圆锥和截面有啥关系吗?

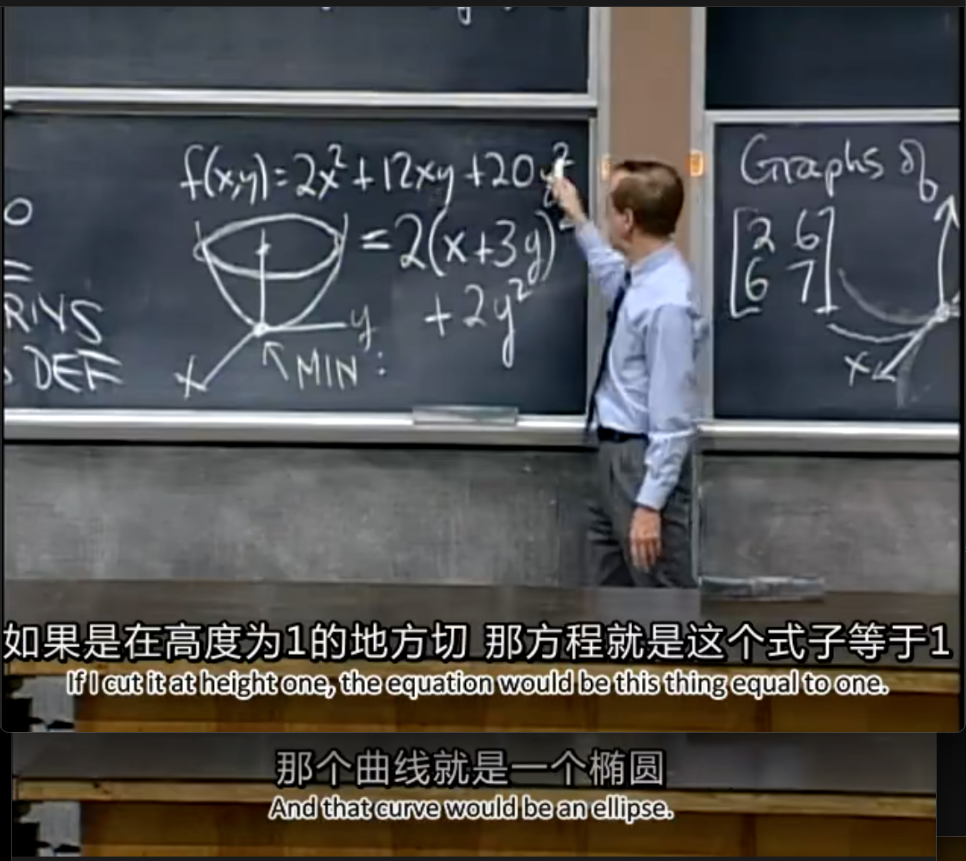

多元函数判断极小值 Test for a Minimum

对于一元函数 ,最低点的情况是一阶导为 0,二阶导大于 0。

对于二元函数 ,当且仅当:

并且 Hessian 矩阵 (S) 正定,即:

类比一元函数对 进行求导,二元函数需要对 和 分别求偏导数(对某个参数求导时,将其他参数视为常数。

其中,梯度指的是多元函数在各个方向上的一阶偏导数组成的向量:

当梯度为 0 时,函数在该点处有极值。

二次函数的二阶导又需要在一阶导的基础上,继续对 和 分别求偏导数,得到四种情况:

-

对 求两次偏导数,得到 。

-

先对 求偏导数,再对 求偏导数,得到 。

-

先对 求偏导数,再对 求偏导数,得到 。

-

对 求两次偏导数,得到 。

Hessian 矩阵指的是多元函数在各个方向上的二阶偏导数组成的矩阵。

更高阶的多元函数同理,共同构成 k 阶张量。

当 Hessian 矩阵正定时,说明在任意方向上都“向上弯”,函数在该点处有极小值。

如何判断弯曲程度,可以用泰勒近似:

因为在 处,,梯度为 0,所以取决于

考虑上面的二次齐次函数,可以看出其形式与二次函数类似。

对于任何非零向量 ,如果 ,即当 Hessian 矩阵正定,函数在该点处弯曲向上,配合梯度为 0 则有极小值。

可以利用以下条件判断 Hessian 矩阵是否正定:

-

且 。

-

特征值均为正数。

秩-零化度定理

像空间和核空间

对于变换,都是将向量从一个空间映射到另一个空间。

所有输出向量构成的集合为像空间,所有被映射到零向量的输入向量构成的集合叫核空间或零空间。

秩-零化度定理:

几何证明:

-

取核空间中的一组基为 ,则 。

-

将基扩展为整个空间 的一组基 ,则 。

-

证明 是 的一组基。

-

线性无关性:假设存在系数 使得

则有

这意味着 。

所以 可以表示为核空间基的线性组合:

因此,

因为 线性无关,所以所有系数均为零:

所以 线性无关。

因此,回到假设可知, 线性无关。

-

张成性:对于任意 ,存在 使得 。将 用基展开:

因为 对所有 成立,

则有

所以 可以表示为 的线性组合。

-

因此, 张成 。

因此,。

综上所述,有

SVD 分解

对于任意 可以分解为 ,其中 和 是正交矩阵, 是对角矩阵,且对角线上的元素非负且按降序排列。

首先考虑试着找到 ,其中 和 分别是 和 的列向量, 是 的对角线元素。这里的几何意义是找到一个在行空间上的单位正交基 ,使得通过 映射到列空间上时,得到的向量 也是正交的,并且每个向量的长度被缩放了一个因子 。

对于零空间中的向量 ,有 ,对应的 。

为了找到这些向量和缩放因子,可以考虑 ,得到

因为 是对称矩阵,可以进行特征值分解,所以 是 的特征向量矩阵, 是对应的特征值对角矩阵。 和 可以计算得到。

以及,,所以 是 的特征向量矩阵, 也是对应的特征值对角矩阵,也可以计算得到。

从四大子空间上看:

对于 ,它们是行空间的基, 映射到列空间上

对于 ,它们是零空间的基, 映射到零向量,对应的 。

对于 ,它们是列空间的基

对于 ,它们是左零空间的基

从几何上看,SVD 分解可以看作是一个线性变换的三个步骤:

-

先旋转:通过正交矩阵 ,将输入向量旋转到一个新的坐标系中。

-

再缩放:通过对角矩阵 ,在新的坐标系中对各个方向进行缩放。

-

最后旋转:通过正交矩阵 ,将缩放后的向量旋转到最终的输出坐标系中。

此外,因为 是半正半定矩阵,所以它的特征值非负,因此 的对角线元素 也是非负的。